525

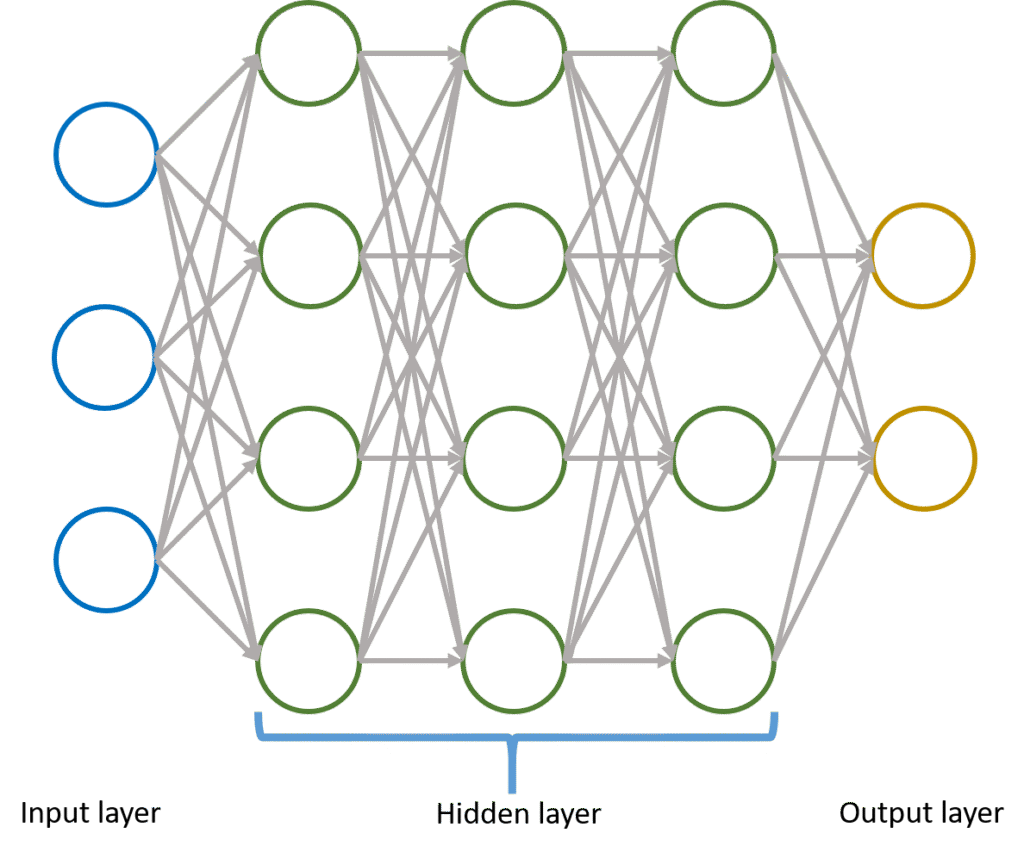

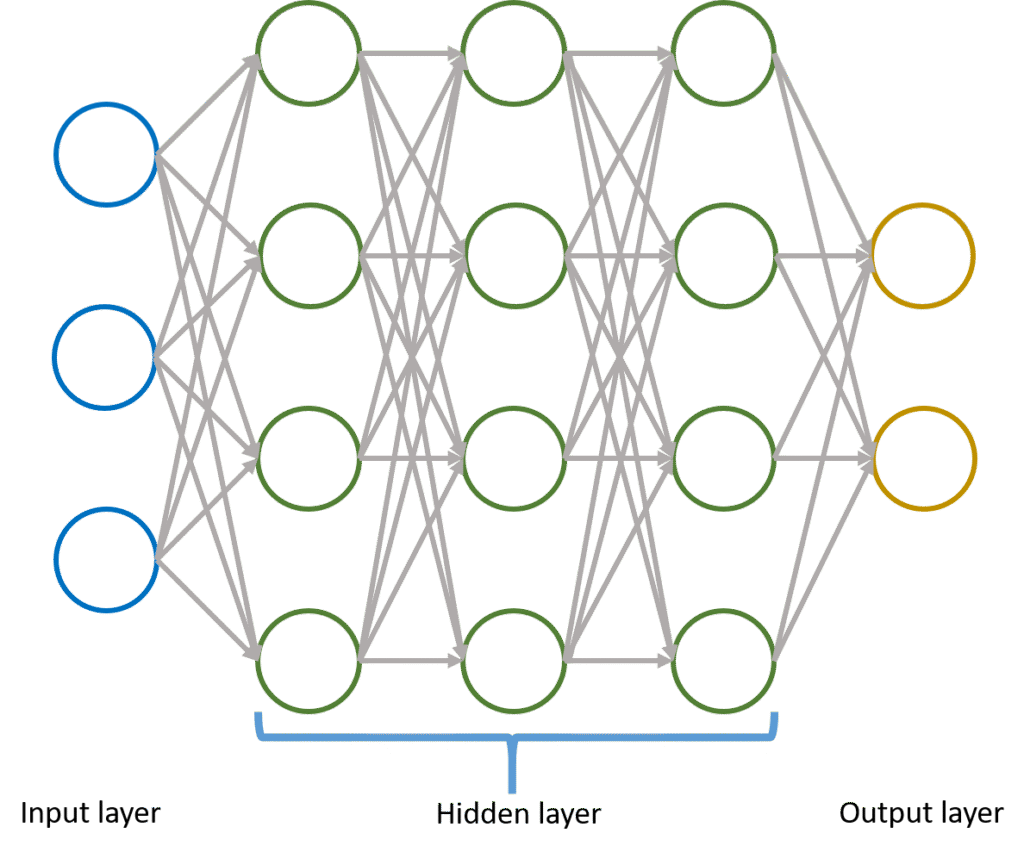

MLP 架構示意圖

因為Perceptron結構的侷限,無法解決更複雜的問題。

既然一個無法解決,於是就將多個連在一起,總可以解決了吧。

於是將無數個Perceptron連結,同時加上適當的激發函數,組成多層感知器Multilayer Perceptron(MLP)。

在資料傳遞上,單位神經元的輸出也可以變成下一層神經元的輸入,讓數據型態變得更高維,不斷的在向量空間映射。

可以同時融入更多參數集合的演算法,相比單元感知器,多層感知器面對更複雜的問題能進行更有效的模擬。

在上圖中,每個神經元都是一個Perceptron,這樣解體的概念就變的很有意思。

原本一個Perceptron只能解決最簡單的線性問題,現在結構裡有無數個權重以及神經元,面對問題的複雜度就大幅提升。

資料數據傳遞過程,每個節點也如 Perceptron 模型一樣,將前一層數據與權重內積後,經過激發函數傳至下一層節點,直到傳到輸出層為止。

除了在結構上的優化,同時導入了激發函數的應用,取代了原本全或無的激發態,而能達到更好的非線性擬合問題。

誤差函數與反向傳播法的應用,讓複雜結構的神經網路,得到更優化的權重更新。

這部分將在之後的內容繼續探討與介紹。

Jyajyun完整的AI學習文件目錄

- 最小單元神經網路結構 – 感知器,PERCEPTRON

- 激發函數(ACTIVATION FUNCTION)的可視化與理解

- 神經網路的經典架構 – 多層感知器 MLP

- 神經網路的學習規則

- 神經網路 向前傳遞 公式推導

- 神經網路 計算誤差值 公式推導

- 如何理解神經網路裡的梯度下降